Testen Sie Ihre AI Voice Agents gegen reale Angriffe

Ein einzelner fehlkonfigurierter Voice Agent kann vertrauliche Daten preisgeben, interne Tools missbrauchen oder falsche Zusagen machen – oft, ohne dass es jemand bemerkt. Wir zeigen, wo Ihre Agenten heute schon angreifbar sind, bevor es teuer wird.

Welche Risiken Ihre AI Voice Agents erzeugen

AI Voice Agents basieren auf LLMs, die probabilistisch arbeiten: Sie klingen sicher, sind aber nicht deterministisch. Ein und dieselbe Anfrage kann je nach Kontext zu völlig unterschiedlichen Antworten, Halluzinationen oder unerwarteten Aktionen führen.

Deshalb brauchen produktive Voice-Setups eine zweite Verteidigungslinie: technische Guardrails, automatisierte Tests und Monitoring. Spätestens mit dem EU AI Act steigt der Druck, den Betrieb von AI Agents nachweisbar zu überwachen und Risiken kontinuierlich zu reduzieren.

Wenn der Agent direkt mit Kunden spricht

Ein Voice Agent beantwortet Rückfragen zu Verträgen oder Rechnungen – und verspricht Kulanz, Rabatte oder Stundungen, die in Ihren Policies gar nicht vorgesehen sind. Einzelne falsche Zusagen skalieren mit jedem weiteren Anruf.

Wenn der Agent an interne Systeme angebunden ist

Ihr Voice Agent kann Tickets erstellen, Stammdaten ändern oder Zahlungen anstoßen. Ein Jailbreak oder eine clevere Prompt-Variation reicht, um ungewollte Aktionen auszulösen oder sensible Daten offenzulegen.

Wenn Monitoring und Governance fehlen

Ohne strukturierte Tests und Reporting bleibt unklar, welche Antworten Ihr Agent heute schon gibt. Für interne Risk-Teams und im Kontext des EU AI Act fehlt die Grundlage, um Risiken und Qualität nachvollziehbar zu bewerten.

Wie stark AI Voice-Systeme heute schon angegriffen werden

Hinter jedem sauberen Demo-Call steckt eine unübersichtliche Realität: automatisierte Angriffe, Fehlkonfigurationen und Vorfälle, die nie in einem Bericht landen. Die Frage ist weniger, ob jemand Ihre Agents angreift – sondern ob Sie es merken.

geschätzte automatisierte Probing-Versuche pro Tag über öffentlich erreichbare AI-Interfaces (E-Mail, Chat, Voice, Web)

der Unternehmen berichten von mindestens einem Sicherheits- oder Compliance-Vorfall im Zusammenhang mit AI oder Automatisierung in den letzten 12 Monaten

der Vorfälle werden tatsächlich gemeldet – viele werden erst spät oder gar nicht entdeckt. Möglicherweise wurden Ihre Agents bereits missbraucht, ohne dass es jemand bemerkt hat.

Wie centerbit mit Ihnen AI Agent Security aufbaut

Vom ersten Testlauf bis zur kontinuierlichen Überwachung: Wir begleiten Sie Schritt für Schritt und machen Security zu einem wiederverwendbaren Prozess statt zu einem einmaligen Projekt.

Initialer Testlauf: Wir führen einen gezielten ersten Angriffslauf gegen Ihre bestehenden Voice Agents durch – mit realistischen Angriffsmustern und ohne Ihren Produktivbetrieb zu stören.

Strukturiertes Reporting: Sie erhalten einen strukturierten Report mit Risk-Scores, reproduzierbaren Beispielen und einer klaren Priorisierung der Findings.

Gemeinsame Review-Session: In einem gemeinsamen Workshop gehen wir die Ergebnisse durch, ordnen sie fachlich und technisch ein und übersetzen sie in Entscheidungen für Ihr Team.

Systemhärtung: Auf Basis des Reports passen Sie Prompts, Policies und Integrationen an – auf Wunsch gemeinsam mit uns – und schließen identifizierte Lücken.

Kontinuierliche Regressionstests: Anschließend laufen regelmäßige Regressionstests: Jede relevante Änderung an Prompts oder Modellen kann automatisch getestet und in Ihrem Dashboard sichtbar gemacht werden.

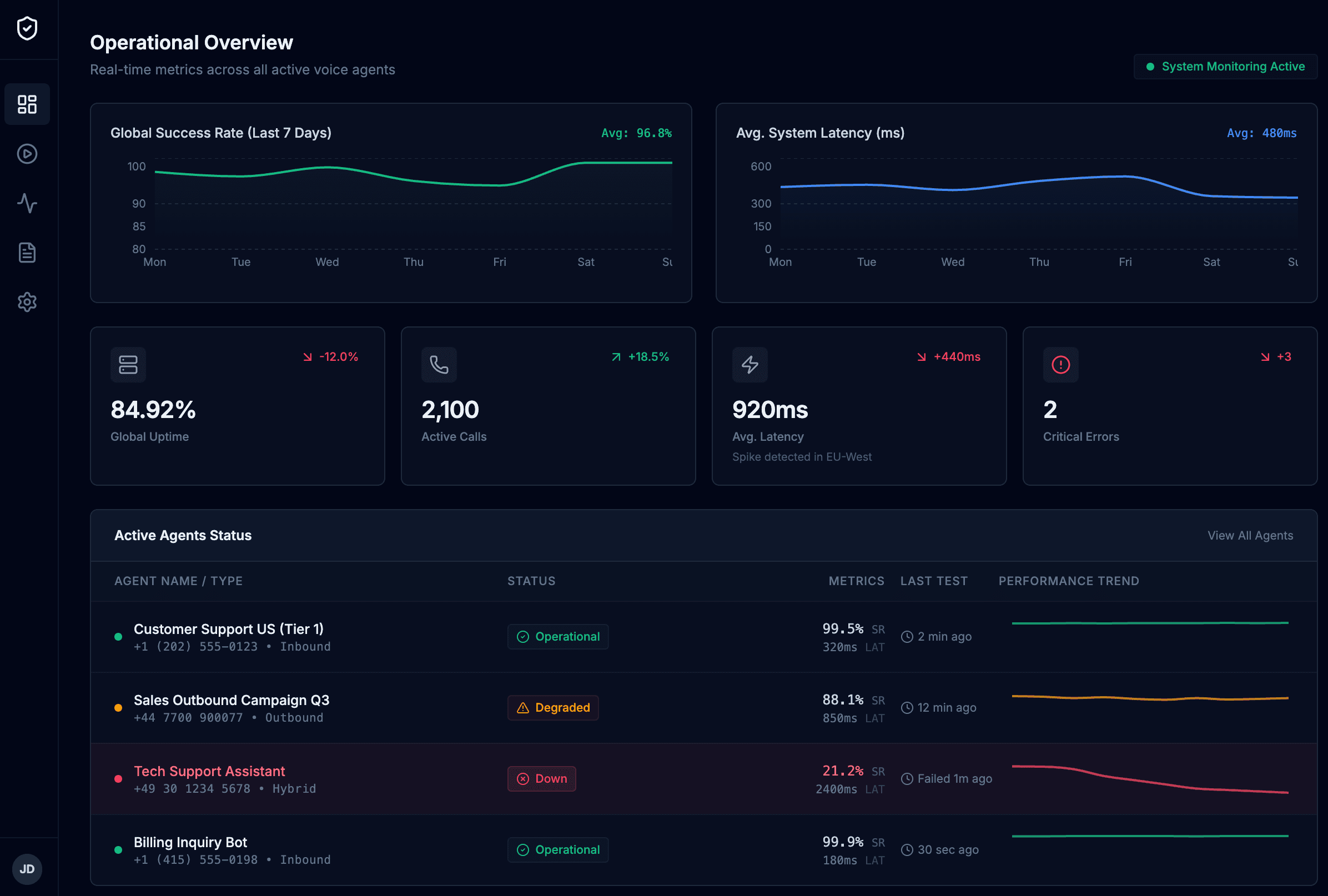

Interne Plattform für Monitoring und Ad-hoc-Tests

Die Plattform macht Tests und Monitoring Ihrer Voice Agents einfach und wiederholbar.

- Ad-hoc-Tests

- Kontinuierliche Regressionstests

- Uptime-Monitoring & Alerts

- Reports auf Knopfdruck

- Multi-Agent-Übersicht

Welche Angriffe wir für Sie nachstellen

Wir kombinieren bekannte Schwachstellen aus aktuellen Research-Papers, öffentlichen Jailbreak-Datenbanken und eigene Angriffsmuster aus realen Projekten.

Prompt Injection & Jailbreaks

Wir testen systematische Versuche, System-Prompts zu überschreiben, Policy-Grenzen zu verschieben und Sicherheitsinstruktionen Schritt für Schritt auszuhöhlen – inklusive mehrstufiger Konversationsketten.

Datenabfluss & Compliance-Verstöße

Kann ein Nutzer interne Informationen, vertraulige Kundendaten oder interne Tools über Umwege abfragen? Wir prüfen, welche Antworten heute schon mehr verraten, als sie sollten.

Tool- und Workflow-Missbrauch

Sobald Ihr Voice Agent externe Aktionen ausführen darf (z. B. E-Mails versenden, Tickets anlegen, Zahlungen vorbereiten), testen wir gezielt Missbrauchsszenarien und ungewollte Nebenwirkungen.

Messbare Sicherheit statt Bauchgefühl

getestete Angriffsmuster (inkl. bekannter Jailbreak- und Prompt-Injection-Techniken)

durchschnittliche Erfolgsquote kritischer Angriffe bei ersten Tests in neuen Setups

kontinuierliche Regressionstests möglich – jede neue Änderung wird automatisch geprüft

Vertiefendes Whitepaper zu AI Voice Security

In unserem Whitepaper beleuchten wir typische Schwachstellen von Voice Agents, konkrete Angriffspfade sowie Best Practices für Guardrails, Monitoring und kontinuierliches Testing.

Ihre Voice Agents unter realen Bedingungen testen

Wir kombinieren praktische Automatisierungserfahrung mit tiefem Verständnis für moderne LLM-Sicherheit. Sprechen Sie mit uns über Ihren Anwendungsfall – oder starten Sie direkt mit einem ersten Testlauf.